A pesquisa de agentes de IA da SailPoint descobriu que 80% das organizações relatam que seus agentes de IA realizaram ações não intencionais. Apenas 44% têm políticas formais de governação em vigor. Essa diferença de 36 pontos não é um bug. É o estado operacional padrão da maioria das implantações de IA atualmente. E a solução que a maioria das equipes busca primeiro torna tudo pior.

Por que os agentes de IA se contradizem?

Três agentes de IA. Um cliente. Uma semana.

Seu agente de marketing envia um e-mail de posicionamento premium na segunda-feira. Seu agente de vendas segue com uma oferta de desconto na quarta-feira. Seu agente de suporte dispara uma sequência de recuperação na sexta-feira porque a conta ficou silenciosa.

Todos os três tinham dados de clientes idênticos. Todos os três estavam otimizando para seus próprios objetivos. O cliente, com uma renovação de US$ 200.000, encaminhou todos os três e-mails para seu vice-presidente de vendas: “Alguém pode me dizer o que realmente está acontecendo lá?”

Os dados eram perfeitos. A autoridade estava faltando.

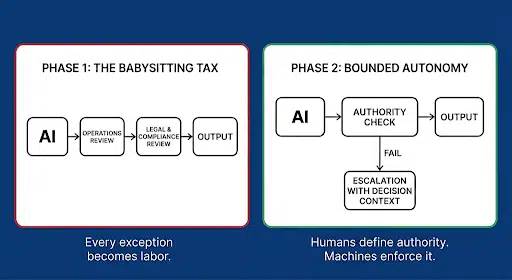

Então, o que cada equipe faz a seguir? Reinstale a revisão humana. Coloque uma pessoa no circuito entre cada ação de IA e cada ponto de contato com o cliente. Parece responsável.

É a não solução mais cara disponível.

Se um ser humano aprovar cada resultado de IA antes de ser enviado, você não automatizou a decisão. Você automatizou o rascunho e manteve o gargalo. Em dois trimestres, a sua IA criou mais trabalho de correção do que eliminou. Seu CFO está financiando uma camada de babá em vez de uma camada de alavancagem.

Quando a demanda excede a capacidade, “revisar tudo” silenciosamente se transforma em “não revisar nada”.

Por que os dados compartilhados não resolvem o problema da autoridade?

O problema não são os agentes. O problema é que ninguém disse aos agentes o que possuíam.

Um CDP pode dizer a cada agente quem é o cliente. Ela não pode dizer a nenhum agente o que está autorizado a se comprometer em nome daquele cliente. Você pode ter dados puros e unificados e ainda assim receber promessas conflitantes. A pilha precisa de uma camada de decisão que governe o que um agente pode fazer com os dados que vê.

A estrutura de tela combinável identifica corretamente “dados de controle” como uma camada central da pilha moderna de martech: políticas, permissões, proteções. A arquitetura está certa. O que não responde é quem detém a autoridade para agir dentro dessas barreiras e sob que condições exactas.

Até que esses direitos de decisão sejam explícitos e legíveis por máquina, os dados de controle são contexto e não autoridade.

A orientação federal sobre IA confiável está chegando ao mesmo lugar. Os guardrails devem ser testados, as razões devem ser rastreáveis e a supervisão humana deve ser reservada para as condições limite e não para todos os resultados. Os dados compartilhados podem informar um agente. Não pode autorizar um.

O que a autoridade delegada realmente exige?

Autoridade delegada significa codificar três categorias de regras para cada decisão que um agente pode tomar usando a Estrutura POP:

- Permissões definir o que o agente pode fazer de forma autônoma e em que condições.

- Obrigações definir o que deve sempre fazer sempre que determinados gatilhos ocorrerem.

- Proibições definir o que nunca deve fazer, independentemente da pressão de otimização.

Estas regras não podem residir num documento político. Um agente não lê seu manual de conformidade. Eles precisam viver em uma camada de fiscalização que seja executada antes que qualquer ação chegue ao cliente. O agente consulta a camada. A camada retorna uma passagem, uma bandeira ou uma parada brusca. Cada decisão gera um registro automaticamente.

Pense nisso como a API do livro de regras da sua empresa.

Quando essa camada existe, o cenário de três agentes funciona de forma diferente. O marketing envia o e-mail de posicionamento. As vendas consultam a camada de autoridade antes do desconto, encontram um sinalizador de que a conta está em renovação ativa e encaminham para um humano em vez de disparar. O suporte vê o sinalizador de escalonamento e mantém a sequência de recuperação.

Uma interação com o cliente. Coordenado. Coerente.

Há uma subtileza que a maioria das conversas sobre governação ignora. Mesmo quando a autoridade é definida, se diferentes agentes interpretarem o mesmo termo de forma diferente, você ainda obterá resultados inconsistentes. Se o marketing lê “cliente de alto valor” como um gasto vitalício de US$ 100 mil, e o suporte lê isso como um contrato ativo de US$ 50 mil, a autoridade varia entre os contextos. A consistência da interpretação é um requisito estrutural da própria camada de aplicação.

Obtenha insights importantes da MarTech

Notícias da plataforma, análise estratégica e tendências do setor. Aprovado por mais de 40.000 profissionais de marketing.

O que acontece quando a camada de autoridade não existe?

Se seus agentes de IA estiverem otimizados, mas descoordenados, o problema não é a camada de dados. É a camada de autoridade.

Defina o que cada agente possui, o que requer escalonamento e o que requer uma parada brusca. Codifique-o. Aplique-o. Até que essa camada exista, você não estará executando uma pilha de IA governada. Você está executando um mecanismo de improvisação muito rápido com marca premium.

A camada de aplicação que impulsiona esta mudança é a Arquitetura de Decisão. Mas um portão sem estrutura subjacente é apenas um muro. A autoridade delegada atua como o “wireframe”, dando aos líderes de tecnologia e negócios uma linguagem compartilhada para definir os requisitos de IA sem entrar em detalhes. Ele garante a responsabilidade do construtor e transforma a IA de uma caixa preta em uma caixa de vidro.

Esse custo invisível tem nome. Mas, primeiro, há um problema de dados oculto.

Fonte ==> Istoé