No fim de semana, Andrej Karpathy – o influente ex-líder e cofundador da Tesla AI e ex-membro da OpenAI que cunhou o termo "codificação de vibração"— postou no X sobre seu novo projeto de código aberto, autoresearch.

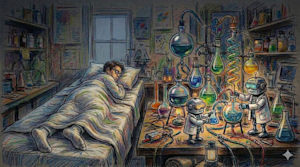

Não era um modelo acabado ou um produto corporativo massivo: era, como ele mesmo admitiu, um script simples de 630 linhas disponibilizado no Github sob uma licença MIT permissiva e amigável para empresas. Mas a ambição era enorme: automatizar o método científico com agentes de IA enquanto nós, humanos, dormimos.

"O objetivo é projetar seus agentes para fazer o progresso mais rápido da pesquisa indefinidamente e sem qualquer envolvimento seu," ele afirmou em X.

O sistema funciona como um ciclo de otimização autônomo. Um agente de IA recebe um script de treinamento e um orçamento de computação fixo (normalmente 5 minutos em uma GPU).

Ele lê seu próprio código-fonte, forma uma hipótese de melhoria (como alterar a taxa de aprendizado ou a profundidade da arquitetura), modifica o código, executa o experimento e avalia os resultados.

Se a perda de validação – medida em bits por byte (val_bpb)—melhora, mantém a mudança; caso contrário, ele reverte e tenta novamente. Em em uma corrida noturna, o agente de Karpathy completou 126 experimentosreduzindo a perda de 0,9979 para 0,9697.

Hoje, Karpathy relatou que depois de deixar o agente sintonizar um "profundidade=12" modelo por dois dias, processou com sucesso aproximadamente 700 alterações autônomas.

O agente encontrou cerca de 20 melhorias aditivas que foram perfeitamente transferidas para modelos maiores. Acumular essas mudanças derrubou o "Hora de GPT-2" métrica na tabela de classificação de 2,02 horas para 1,80 horas – um ganho de eficiência de 11% em um projeto que Karpathy acreditava já estar bem ajustado.

"Ver o agente fazer todo esse fluxo de trabalho de ponta a ponta e sozinho… é incrível," Karpathy comentou, observando que o agente detectou descuidos no dimensionamento e regularização da atenção que ele havia perdido manualmente ao longo de duas décadas de trabalho.

Isso é mais do que apenas um hack de produtividade; é uma mudança fundamental na forma como a inteligência é refinada. Ao automatizar o "método científico" para o código, Karpathy transformou o aprendizado de máquina em um processo evolutivo que funciona na velocidade do silício, e não na velocidade do pensamento humano.

E mais do que isso, mostrou à comunidade mais ampla de IA e aprendizado de máquina no X que esse tipo de processo poderia ser aplicado muito além da ciência da computação, em áreas como marketing, saúde e, bem, basicamente qualquer coisa que exija pesquisa.

A autopesquisa se espalha por toda parte

A reação foi rápida e viral, com a postagem de Karpathy obtendo mais de 8,6 milhões de visualizações nos dois dias seguintes, enquanto construtores e pesquisadores lutavam para dimensionar o "Loop dos Cárpatos".

Varun Mathur, CEO da plataforma agregadora de ferramentas de IA Hyperspace AI, pegou o loop de agente único e o distribuiu por uma rede ponto a ponto. Cada nó que executa o agente Hiperespaço tornou-se um pesquisador autônomo.

Na noite de 8 para 9 de março, 35 agentes autônomos da rede Hiperespaço realizaram 333 experimentos completamente sem supervisão. Os resultados foram uma masterclass em estratégia emergente:

-

Diversidade de hardware como recurso: Mathur observou que embora as GPUs H100 usassem "força bruta" para encontrar taxas de aprendizagem agressivas, os agentes somente com CPU em laptops foram forçados a ser inteligentes. Esses "azarão" os agentes se concentravam em estratégias de inicialização (como Kaiming e Xavier init) e opções de normalização porque não podiam confiar na taxa de transferência bruta.

-

Descoberta baseada em fofocas: Usando o protocolo GossipSub, os agentes compartilharam suas vitórias em tempo real. Quando um agente descobriu que a inicialização do Kaiming reduziu as perdas em 21%, a ideia se espalhou pela rede como um vírus digital. Em poucas horas, outros 23 agentes incorporaram a descoberta em suas próprias hipóteses.

-

A compressão da história: Em apenas 17 horas, esses agentes redescobriram de forma independente marcos de ML, como o RMSNorm e os embeddings vinculados, que levaram quase oito anos para serem formalizados por pesquisadores humanos em laboratórios como Google Brain e OpenAI.

Execute 36.500 experimentos de marketing por ano, em vez de 30

Enquanto os puristas do ML se concentravam nas curvas de perdas, o mundo dos negócios assistiu a um tipo diferente de revolução. Eric Siu, fundador da agência de publicidade Single Grain, aplicou a autopesquisa ao "Ciclo Experimental" de marketing.

"A maioria das equipes de marketing realiza cerca de 30 experimentos por ano," Siu escreveu no X. "A próxima geração terá mais de 36.500 unidades. Facilmente." Ele continuou:

"Eles farão experimentos enquanto dormem. As equipes de marketing atuais realizam de 20 a 30 experimentos por ano. Talvez 52 se forem ‘bons’. Nova página de destino. Novo criativo de anúncio. Talvez um teste de linha de assunto. Isso é considerado "marketing baseado em dados."

Mas a próxima geração de sistemas de marketing realizará mais de 36.500 experimentos por ano."

A estrutura de Siu substitui o script de treinamento por um ativo de marketing – uma página de destino, um criativo de anúncio ou um e-mail frio. O agente modifica uma variável (a linha de assunto ou CTA), implanta-a, mede o "taxa de resposta positiva," e mantém ou descarta.

Siu argumenta que isso cria um "mapa proprietário" daquilo que ressoa com um público específico – um fosso construído não de código, mas de história de experimentos. "As empresas vencedoras não terão profissionais de marketing melhores," ele escreveu, "eles terão ciclos de experimentos mais rápidos".

Discussão comunitária e ‘estragar’ o conjunto de validação

Apesar do fervor, as Discussões do GitHub revelaram uma comunidade lutando com as implicações de um progresso tão rápido e automatizado.

A armadilha da otimização excessiva: O pesquisador alexisthual levantou uma preocupação comovente: "Você não está preocupado com o fato de que o lançamento de tantos experimentos acabará “estragando” o conjunto de validação?". O temor é que, com agentes suficientes, os parâmetros sejam otimizados para as peculiaridades específicas dos dados de teste, em vez da inteligência geral.

O significado dos ganhos: O usuário samionb questionou se uma queda de 0,9979 para 0,9697 era realmente perceptível. A resposta de Karpathy foi caracteristicamente direta: "Tudo o que estamos fazendo é otimizar o desempenho por computação… esses são ganhos reais e substanciais"

O Elemento Humano: No X, o usuário witcheer, chefe de crescimento da plataforma de criptografia Yari Finance, documentou sua própria execução noturna em um Mac Mini M4, observando que, embora 26 dos 35 experimentos falharam ou travaram, os sete que tiveram sucesso revelaram que "o modelo melhorou ficando mais simples".

Esta percepção – de que menos é muitas vezes mais – foi alcançada sem uma única intervenção humana.

O futuro: a curiosidade como gargalo

O lançamento da pesquisa automática sugere um futuro de pesquisa em domínios onde, graças a mecanismos simples de instrução de IA, o papel do ser humano muda de "experimentador" para "projetista experimental."

À medida que ferramentas como DarkMatter, Optimization Arena e NanoClaw surgem para apoiar esse enxame, o gargalo do progresso da IA não é mais o "computador de carne" (A descrição de Karpathy da capacidade do cérebro humano) de codificar – é a nossa capacidade de definir as restrições da pesquisa.

Andrej Karpathy mais uma vez mudou o clima. Não somos mais apenas modelos de codificação; estamos semeando ecossistemas que aprendem enquanto dormimos.

Fonte ==> Cyberseo