Participe de nossos boletins diários e semanais para obter as atualizações mais recentes e conteúdo exclusivo sobre a cobertura de IA líder do setor. Saber mais

Na corrida para implantar a IA corporativa, um obstáculo bloqueia consistentemente o caminho: alucinações. Essas respostas fabricadas dos sistemas de IA causaram tudo, desde sanções legais para advogados a empresas sendo forçadas a honrar políticas fictícias.

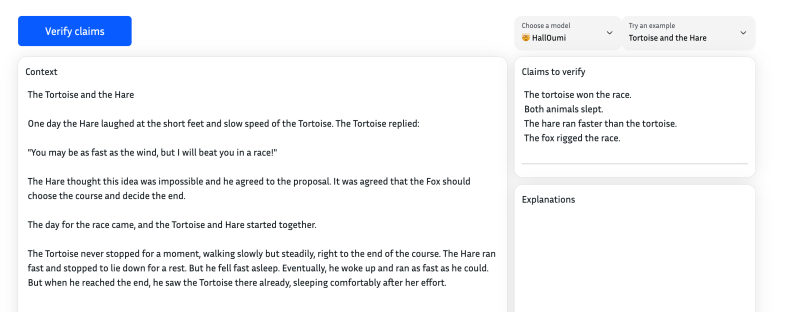

As organizações tentaram diferentes abordagens para Resolvendo o desafio de alucinação, incluindo ajuste fino com melhores dados, geração aumentada de recuperação (RAG) e corrimão. Código aberto A empresa de desenvolvimento Oumi agora está oferecendo uma nova abordagem, embora com um nome de queijo um tanto queija.

O O nome da empresa é um acrônimo para a Universal Machine Intelligence (OUMI). É liderado por ex-aplicativos e engenheiros do Google em uma missão para construir uma fonte aberta incondicionalmente Você tem uma plataforma.

Em 2 de abril, a empresa divulgou o Halloumi, um modelo de verificação de reivindicações de código aberto projetado para resolver o problema de precisão por meio de uma nova abordagem da detecção de alucinação. Halloumi é, obviamente, um tipo de queijo duro, mas isso não tem nada a ver com a nomeação do modelo. O nome é uma combinação de alucinação e oumi, embora o momento do lançamento perto do dia de April Fools possa ter feito alguns suspeitos que o lançamento fosse uma piada – mas é tudo menos uma piada; É uma solução para um problema muito real.

“As alucinações são frequentemente citadas como um dos desafios mais críticos na implantação de modelos generativos”, disse Manos Koukoumidis, CEO da Oumi, à VentureBeat. “Em última análise, tudo se resume a uma questão de confiança – modelos generativos são treinados para produzir saídas provavelmente prováveis, mas não necessariamente verdadeiras”.

Como Halloumi trabalha para resolver alucinações corporativas da IA

O Halloumi analisa o conteúdo gerado pela IA, em uma base de frase por frase. O sistema aceita um documento de origem e uma resposta de IA e determina se o material de origem suporta cada reclamação na resposta.

“O que Halloumi faz é analisar todas as frases de forma independente”, explicou Koukoumidis. “Para cada frase que ele analisa, ele informa as frases específicas no documento de entrada que você deve verificar, para que você não precise ler o documento inteiro para verificar se o que o LLM (Modelo de Linguagem Grande) disse ser preciso ou não.”

O modelo fornece três saídas principais para cada frase analisada:

- Uma pontuação de confiança indicando a probabilidade de alucinação.

- Citações específicas que ligam as reivindicações de apoiar evidências.

- Uma explicação legível por humanos detalhando por que a reivindicação é suportada ou não suportada.

“Nós treinamos para ser muito sutil”, disse Koukoumidis. “Mesmo para nossos linguistas, quando o modelo sinaliza algo como uma alucinação, inicialmente pensamos que parece correto. Então, quando você olha para a lógica, Halloumi aponta exatamente a razão diferenciada pela qual é uma alucinação – por que o modelo estava fazendo algum tipo de suposição, ou por que é imprecisa de uma maneira muito sutil.”

Integração de Halloumi nos fluxos de trabalho corporativos da IA

Existem várias maneiras pelas quais o Halloumi pode ser usado e integrado à IA Enterprise hoje.

Uma opção é experimentar o modelo usando um processo um tanto manual, embora a interface de demonstração on -line.

Uma abordagem orientada à API será mais ideal para os fluxos de trabalho de produção e IA corporativos. Manos explicou que o modelo é totalmente aberto e pode ser conectado aos fluxos de trabalho existentes, executado localmente ou na nuvem e usado com qualquer LLM.

O processo envolve a alimentação do contexto original e a resposta do LLM a Halloumi, que verifica a saída. As empresas podem integrar o Halloumi para adicionar uma camada de verificação aos seus sistemas de IA, ajudando a detectar e prevenir alucinações em conteúdo gerado pela IA.

O OMI lançou duas versões: o modelo generativo 8B que fornece análises detalhadas e um modelo de classificador que oferece apenas uma pontuação, mas com maior eficiência computacional.

Halloumi vs Rag vs Guardrails para Proteção de Hallucinação de AI Enterprise

O que diferencia o Halloumi de outras abordagens de aterramento é como ele complementa, em vez de substituir técnicas existentes como RAG (geração aumentada de recuperação), oferecendo análises mais detalhadas do que os guardares típicos.

“O documento de entrada que você alimenta através do LLM pode ser RAG”, disse Koukoumidis. “Em alguns outros casos, não é com precisão, porque as pessoas dizem: ‘Não estou recuperando nada. Já tenho o documento que me preocupo. Estou lhe dizendo, esse é o documento com o qual me preocupo. Resumi -o para mim.’ Então, Halloumi pode se aplicar ao RAG, mas não apenas aos cenários de trapos. ”

Essa distinção é importante porque, embora o RAG visa melhorar a geração, fornecendo contexto relevante, Halloumi verifica a saída após a geração, independentemente de como esse contexto foi obtido.

Comparado aos corrimãos, Halloumi fornece mais do que verificação binária. Sua análise no nível da sentença com pontuações e explicações de confiança oferece aos usuários uma compreensão detalhada de onde e como ocorrem alucinações.

Halloumi incorpora uma forma especializada de raciocínio em sua abordagem.

“Definitivamente, havia uma variante do raciocínio que fizemos para sintetizar os dados”, explicou Koukoumidis. “Orientamos o modelo a raciocinar passo a passo ou reivindicar por subconjunto, a pensar em como ele deve classificar uma reivindicação maior ou uma frase maior para fazer a previsão”.

O modelo também pode detectar não apenas alucinações acidentais, mas informações errôneas intencionais. Em uma demonstração, Koukoumidis mostrou como Halloumi se identificou quando o modelo de Deepseek ignorou o conteúdo da Wikipedia e, em vez disso, gerou conteúdo semelhante a propaganda sobre a resposta CoVid-19 da China.

O que isso significa para a adoção da IA corporativa

Para empresas que desejam liderar o caminho na adoção da IA, o Halloumi oferece uma ferramenta potencialmente crucial para implantar com segurança sistemas generativos de IA em ambientes de produção.

“Eu realmente espero que isso desbloqueie muitos cenários”, disse Koukoumidis. “Muitas empresas não podem confiar em seus modelos porque as implementações existentes não eram muito ergonômicas ou eficientes. Espero que Halloumi lhes permita confiar em seus LLMs porque agora têm algo para instilar a confiança de que precisam”.

Para empresas em uma curva de adoção de IA mais lenta, a natureza de código aberto de Halloumi significa que eles podem experimentar a tecnologia agora, enquanto a Oumi oferece opções de suporte comercial conforme necessário.

“Se alguma empresa deseja personalizar melhor o Halloumi em seu domínio ou ter alguma maneira comercial específica de que deve usá -lo, sempre estamos muito felizes em ajudá -los a desenvolver a solução”, acrescentou Koukoumidis.

À medida que os sistemas de IA continuam avançando, ferramentas como o Halloumi podem se tornar componentes padrão das pilhas de IA corporativas – infraestrutura essencial para separar o fato da AI da ficção.

Insights diários sobre casos de uso de negócios com VB diariamente

Se você deseja impressionar seu chefe, o VB Daily o cobriu. Damos a você uma informação interna sobre o que as empresas estão fazendo com a IA generativa, desde mudanças regulatórias a implantações práticas, para que você possa compartilhar informações para o ROI máximo.

Leia nossa Política de Privacidade

Obrigado por assinar. Confira mais boletins de VB aqui.

Ocorreu um erro.

Fonte ==> Cyberseo