Junte -se ao evento confiável pelos líderes corporativos por quase duas décadas. A VB Transform reúne as pessoas que construíram a estratégia de IA da empresa real. Saber mais

Pesquisadores do MIT desenvolveram uma estrutura chamada Modelos de Idiomas Auto-adaptadores (SEAL) que permitem que os grandes modelos de linguagem (LLMS) aprendam continuamente e se adaptem, atualizando seus próprios parâmetros internos. O Seal ensina um LLM a gerar seus próprios dados de treinamento e atualizar as instruções, permitindo que ele absorva permanentemente novos conhecimentos e aprenda novas tarefas.

Essa estrutura pode ser útil para aplicativos corporativos, principalmente para agentes de IA que operam em ambientes dinâmicos, onde devem processar constantemente novas informações e adaptar seu comportamento.

O desafio de adaptar LLMs

Embora grandes modelos de idiomas tenham mostrado habilidades notáveis, adaptar -as a tarefas específicas, integrando novas informações ou dominar novas habilidades de raciocínio continua sendo um obstáculo significativo.

Atualmente, quando confrontado com uma nova tarefa, os LLMs normalmente aprendem com os dados “AS-IS” através de métodos como Finetuning ou aprendizado no contexto. No entanto, os dados fornecidos nem sempre estão em um formato ideal para o modelo aprender com eficiência. As abordagens existentes não permitem que o modelo desenvolva suas próprias estratégias para melhor transformar e aprender com novas informações.

“Muitos casos de uso corporativo exigem mais do que apenas recall factual-eles exigem adaptação mais profunda e persistente”, disse Jyo Pari, estudante de doutorado do MIT e co-autor do artigo, à VentureBeat. “Por exemplo, um assistente de codificação pode precisar internalizar a estrutura específica de software de uma empresa, ou um modelo voltado para o cliente pode precisar aprender o comportamento ou as preferências exclusivas de um usuário ao longo do tempo”.

Nesses casos, a recuperação temporária fica aquém, e o conhecimento precisa ser “assado” os pesos do modelo, para que influencie todas as respostas futuras.

Criando modelos de linguagem auto-adaptável

“Como um passo em direção à adaptação escalável e eficiente dos modelos de linguagem, propomos equipar os LLMs com a capacidade de gerar seus próprios dados de treinamento e diretivas de Finetuning para usar esses dados”, afirmam os pesquisadores do MIT em seu artigo.

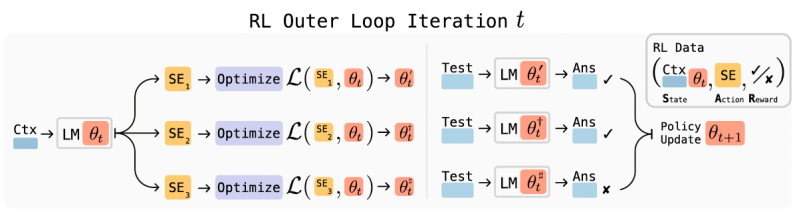

A solução dos pesquisadores é selo, abreviação de modelos de linguagem auto-adaptados. Ele usa um algoritmo de aprendizado de reforço (RL) para treinar um LLM para gerar “auto-edits”-instruções de língua natural que especificam como o modelo deve atualizar seus próprios pesos. Esses auto-editores podem reestruturar novas informações, criar exemplos de treinamento sintético ou até definir os parâmetros técnicos para o próprio processo de aprendizado.

Intuitivamente, o Seal ensina um modelo a criar seu próprio guia de estudo personalizado. Em vez de apenas ler um novo documento (os dados brutos), o modelo aprende a reescrever e reformar essas informações em um estilo que ele pode absorver e internalizar mais facilmente. Esse processo reúne várias áreas-chave da pesquisa de IA, incluindo geração de dados sintéticos, aprendizado de reforço e treinamento em tempo de teste (TTT).

A estrutura opera em um sistema de dois loop. Em um “loop interno”, o modelo usa um auto-edit para executar uma pequena atualização temporária em seus pesos. Em um “loop externo”, o sistema avalia se isso atualizou melhorou o desempenho do modelo em uma tarefa de destino. Se o fizesse, o modelo recebe uma recompensa positiva, reforçando sua capacidade de gerar esse tipo de auto-edição eficaz no futuro. Com o tempo, o LLM se torna um especialista no ensino.

Em seu estudo, os pesquisadores usaram um único modelo para toda a estrutura do selo. No entanto, eles também observam que esse processo pode ser dissociado em um modelo “professor-aluno”. Um modelo de professor especializado pode ser treinado para gerar auto-editores eficazes para um modelo de aluno separado, que seria atualizado. Essa abordagem pode permitir pipelines de adaptação mais especializados e eficientes nas configurações corporativas.

Selo em ação

Os pesquisadores testaram o selo em dois domínios principais: incorporação de conhecimento (a capacidade de integrar permanentemente novos fatos) e aprendizado de poucos tiros (a capacidade de generalizar a partir de um punhado de exemplos).

Para incorporação de conhecimento, o objetivo era ver se o modelo poderia responder a perguntas sobre uma passagem de texto sem ter acesso à passagem durante o interrogatório. A llama finetuning-3.2-1B no texto bruto forneceu apenas uma melhoria marginal em relação ao modelo básico.

No entanto, quando o modelo de vedação criou “auto-editas” gerando várias “implicações” a partir de uma passagem e foi treinado nesses dados sintéticos, sua precisão saltou para 47%. Notavelmente, isso superou os resultados do uso de dados sintéticos gerados pelo GPT-4.1 muito maior, sugerindo o modelo aprendido a criar material de treinamento superior para si.

Para um aprendizado de poucos anos, os pesquisadores testaram selo em exemplos do Corpus de Raciocínio Abstracto (ARC), onde o modelo deve resolver quebra-cabeças visuais. Na fase de auto-edição, o modelo teve que gerar toda a estratégia de adaptação, incluindo quais aumentos de dados e ferramentas para usar e qual taxa de aprendizagem aplicar.

O SEAL alcançou uma taxa de sucesso de 72,5%, uma melhora dramática em relação à taxa de 20% alcançada sem o treinamento de RL e a taxa de 0% da aprendizagem padrão no contexto.

Implicações para a empresa

Alguns especialistas projetam que o fornecimento de dados de treinamento gerado por humanos de alta qualidade pode ser esgotado nos próximos anos. Em breve, o progresso pode depender da “capacidade de um modelo de gerar seu próprio sinal de treinamento de alta utilidade”, como os pesquisadores dizem. Eles acrescentam: “Um próximo passo natural é o meta-treinar um modelo de gerador de dados sintéticos de focas dedicadas que produz novos corpora de pré-treinamento, permitindo que modelos futuros escalarem e obtenham maior eficiência de dados sem depender de texto humano adicional”.

Por exemplo, os pesquisadores propõem que um LLM possa ingerir documentos complexos, como trabalhos acadêmicos ou relatórios financeiros e gerar autonomamente milhares de explicações e implicações para aprofundar seu entendimento.

“Esse laço iterativo de auto-expressão e auto-refinamento pode permitir que os modelos continuem melhorando em tópicos raros ou sub-representados, mesmo na ausência de supervisão externa adicional”, explicam os pesquisadores.

Essa capacidade é especialmente promissora para a construção de agentes de IA. Os sistemas agênticos devem adquirir e reter incrementalmente o conhecimento à medida que interagem com seu ambiente. O selo fornece um mecanismo para isso. Após uma interação, um agente pode sintetizar um auto-edit para desencadear uma atualização de peso, permitindo que ele internalize as lições aprendidas. Isso permite que o agente evolui com o tempo, melhore seu desempenho com base na experiência e reduza sua dependência de programação estática ou orientação humana repetida.

“O Seal demonstra que os grandes modelos de linguagem não precisam permanecer estáticos após a pré -treinamento”, escrevem os pesquisadores. “Ao aprender a gerar seus próprios dados sintéticos de auto-edição e aplicá-los através de atualizações leves de peso, eles podem incorporar autonomamente novos conhecimentos e se adaptar a novas tarefas”.

Limitações do selo

Dito isto, o SEAL não é uma solução universal. Por exemplo, pode sofrer de “esquecimento catastrófico”, onde ciclos constantes de reciclagem podem resultar no aprendizado de seu conhecimento anterior.

“Em nossa implementação atual, incentivamos uma abordagem híbrida”, disse Pari. “As empresas devem ser seletivas sobre o que o conhecimento é importante o suficiente para integrar permanentemente.”

Os dados factuais e em evolução podem permanecer em memória externa através do RAG, enquanto o conhecimento de formação de comportamento de longa duração é mais adequado para atualizações no nível de peso via selo.

“Esse tipo de estratégia de memória híbrida garante que as informações certas sejam persistentes sem sobrecarregar o modelo ou introduzir esquecimento desnecessário”, disse ele.

Também vale a pena notar que o Seal leva uma quantidade de tempo não trivial para ajustar os exemplos de auto-edit e treinar o modelo. Isso torna a edição contínua e em tempo real inviável na maioria das configurações de produção.

“Prevemos um modelo de implantação mais prático em que o sistema coleta dados ao longo de um período-digamos, algumas horas ou um dia-e depois realiza auto-editores direcionados durante intervalos de atualização programados”, disse Pari. “Essa abordagem permite que as empresas controlem o custo de adaptação, enquanto ainda se beneficia da capacidade de Seal de internalizar novos conhecimentos”.

Insights diários sobre casos de uso de negócios com VB diariamente

Se você deseja impressionar seu chefe, o VB Daily o cobriu. Damos a você uma informação interna sobre o que as empresas estão fazendo com a IA generativa, desde mudanças regulatórias a implantações práticas, para que você possa compartilhar informações para o ROI máximo.

Leia nossa Política de Privacidade

Obrigado por assinar. Confira mais boletins de VB aqui.

Ocorreu um erro.

Fonte ==> Cyberseo